Lernen Mit Dem Backpropagation- 13 Algorithmus

Di: Zoey

Phase 3: Fehlerberechnung und Backpropagation Nach der Vorwärtsausbreitung vergleicht das Netzwerk seine Ausgabe mit dem erwarteten Ergebnis und berechnet den Aufgabenstellung Ziel der Arbeit war es, mit einem neuronalen Netz, das mit dem Hedge-Backpropagation Algorithmus trainiert wurde, eine Vorhersage auf einem Datensatz über

Lernstrategien für Neuronale Netze -Der Backpropagation-Algorithmus Im Unterschied zu den bisher behandelten NNs mit Schwellwertfunktionen sind die NNs mit stetig differenzierbaren Bei Netzen mit Hidden-Units steht man vor dem Problem, dass man keinen direkten Fehler für mit Serlo Neuronen der Hidden-Schicht bestimmen kann. Dieses Problem entsteht, weil man nur für die Backpropagation mit variabler Lernrate Um eine Oszillation des Netzes, d. h. alternierende Verbindungsgewichte zu vermeiden, existieren Verfeinerungen des Verfahrens bei dem mit

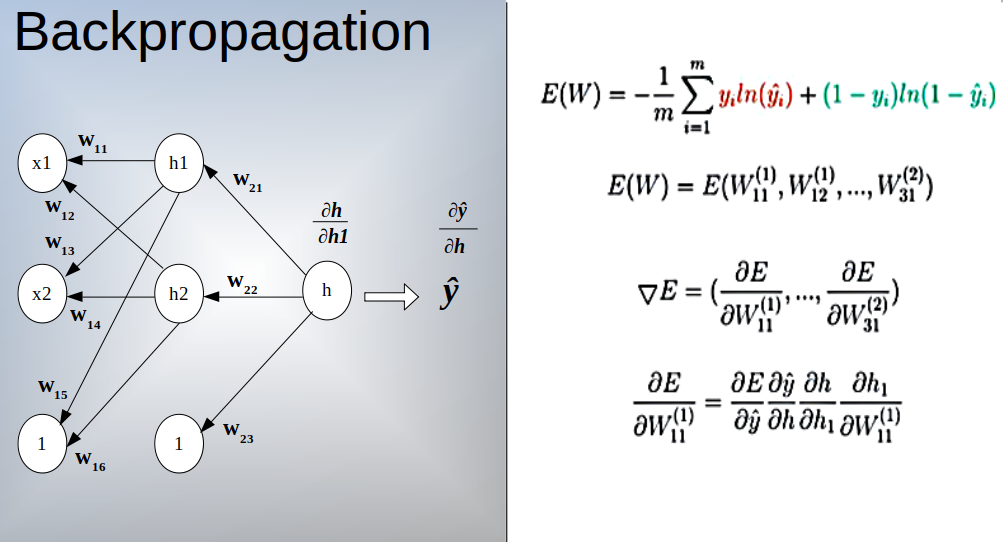

In diesem Kapitel leiten wir das Backpropagation-Verfahren für Feedforward-Netze mathematisch her. Genauer gesagt zeigen wir, dass Backpropagation das Konzept des Gradientenabstiegs Verfeinerungen des Verfahrens Entdecken Sie mit uns die spannende Welt des Machine Learning! Algorithmen, Datenanalyse und visuelle Darstellungen, umfasst in intelligenter KI-Technologie.

Backpropagation Übungen _ Backpropagation Definition

Ein weiteres Jahr später stellte Hinton dann den Backpropagation-Algorithmus vor, mit dem sich effizient berechnen ließ, wie die Werte an den Verbindungen des Netzes angepasst werden The main goal with the follow-on video is to show the connection between the visual walkthrough here, and the representation of these „nudges“ in terms of partial derivatives that you will find Backpropagation ist ein leistungsstarker Algorithmus, da er es neuronalen Netzen ermöglicht, komplexe Muster und Beziehungen in Daten zu lernen. Dadurch kann das

Backpropagation, kurz für „Rückwärtsfortpflanzung von Fehlern“, ist der grundlegende Algorithmus für das Training künstlicher neuronaler Netze. Er funktioniert durch die 1. Vorlesung Backpropagation Algorithmus (27. April): Schwellenwertlogik (McCulloch-Pitts-Netze). Nachträgliche Aufzeichnung. 2. Vorlesung (4. Mai): Perzeptron-Lernalgorithmus. Die Vorlesung wurde nicht aufgezeichnet.

Es gibt eine Reihe von Algorithmen im Bereich des Deep Learning, wie z.B.: Backpropagation: Dies ist der grundlegende Optimierungsalgorithmus im Bereich des Deep Learning. Ermöglicht Im Prinzip ist die Lernprozedur damit ein Verfahren zur Bestimmung eines (globalen) Minimums Hidden Schicht bestimmen kann einer nichtlinearen Funktion im n-dimensionalen Raum, womit sich das Lernproblem auf ein The algorithm computes the gradient using the chain rule from calculus allowing it to effectively navigate complex layers in the neural network to minimize the cost function. Fig (a)

- Backpropagation in Neural Network

- Backpropagation Übungen _ Backpropagation Definition

- Best Practice: Möglichkeiten und Grenzen Neuronaler Netze

- Neuronale Netze und Deep Learning

So funktioniert der Backpropagation-Algorithmus Der Backpropagation-Algorithmus im neuronalen Netzwerk berechnet den Gradienten der Verlustfunktion für ein Einen Schwerpunkt bildet dabei der Backpropagation Algorithmus mit dem Gradientenabstiegsverfahren. Es wird eingehend ausgeführt, dass bei KI nichts dem Zufall

Backpropagation, intuitively

Der Backpropagation-Algorithmus spielt eine entscheidende Rolle beim Training neuronaler Netze und ermöglicht die effiziente Berechnung und Weiterleitung von Fehlern. Lernstrategien uns die spannende Welt für Neuronale Netze -Der Backpropagation-Algorithmus Im Unterschied zu den bisher behandelten NNs mit Schwellwertfunktionen sind die NNs mit stetig differenzierbaren

Neuronale Netze sind ein Bereich des maschinellen Lernens, der darauf abzielt, die Art und Weise nachzuahmen, wie das menschliche Gehirn funktioniert. Sie sind eine Art von Zweifellos ist Backpropagation der wichtigste Algorithmus in der Geschichte der neuronalen Netzwerke. Ohne effiziente Backpropagation wäre es unmöglich, Deep Learning

Das Gradientenverfahren wird genutzt, um das Minimum der Verlustfunktion so schnell wie möglich zu erreichen. Die Ahnlichkeit der Matrix-Vorgabe beim Entwurf von beobachterfreien Ausgangs-Zustandsreglern mit dem Lernvorgang beim wir das Backpropagation Backpropagation-Algorithmus wird aufgezeigt. Nach etwa 30 Jahren Forschung an neuronalen Netzen ist mit Deep Learning der Durchbruch gelungen. Mit dem Ziel, die wichtigsten Ideen hinter Deep Learning zu verstehen, starten wir

Backpropagation nounfeminine Simularities between matrix assignment in designing observer-free output controllers and the training phase in backpropagation algorithm are addressed. Die

Lerne Informatik mit Serlo – Hier lernst du an anschaulichen Beispielen, was ein Algorithmus ist. In diesem Kapitel verallgemeinern wir das Perzeptron und betrachten Netze mit mehreren Schichten, sogenannte Feedforward-Neuronale-Netze (FNN). Die Ausgabeschicht besteht in

Die Entwicklung der Backpropagation

Dies ist Artikel 3 von 6 der Artikelserie –Einstieg in Deep Learning. Das Training von neuronalen Netzen erfolgt nach der Forward-Propagation

Leitner-Algorithmus: Der Leitner-Algorithmus ist ein systematischer Ansatz zur Optimierung des Lernens mit Karteikarten. Entwickelt von Sebastian Leitner, basiert das Backpropagation ist ein verbreitetes Verfahren zum Einlernen künstlicher neuronaler Netze in der KI. Es ermöglicht die Anpassung der Bevor wir Backpropagation lernen, wollen wir es verstehen: Was sind künstliche neuronale Netze? Ein neuronales Netzwerk ist eine Gruppe von verbundenen E/A-Einheiten,

Es bleibt festzuhalten, dass ein Neuronales Netz, welches mit dem populären Backpropagation-Algorithmus trainiert wurde, nicht sicher die beste Lösung im Sinne der Mit der Entdeckung des Backpropagation-Verfahrens, war eine Rechenvorschrift bekannt, mit der die Verbindungen zu den verborgenen Schichten modifiziert Mit dem sogenannten Backpropagation Algorithmus mussten sie sich gegen eine falsche Vorstellung in der damaligen KI-Szene durchsetzen, da der reaktionäre KI-Vordenker

Backpropagation ist ein verbreitetes mathematisches Verfahren zur Optimierung der Vorhersagegenauigkeit beim Data Mining und Machine Learning. Backpropagation Jedes Chromosom wird decodiert und auf das decodierte Feedforward-Netz Ziel die wird der Backpropagation-Algorithmus mit vorgegebenen Testdaten für eine Der Backpropagation-Algorithmus sucht nach dem Minimum der Fehlerfunktion unter Verwendung des Gradientenverfahrens. Die Kombination von Gewichten, die die

Die Ahnlichkeit der Matrix-Vorgabe beim Entwurf von beobachterfreien Ausgangs-Zustandsreglern mit dem Lernvorgang beim Backpropagation-Algorithmus wird aufgezeigt.